摘要

一些有效利他主义者认为,我们行为的大部分预期影响来自于我们如何影响地球已有智能在未来几十亿年的长期发展。根据这种观点,在短期内帮助人类和动物很重要,但主要只是通过对远期结果的影响才重要。

有一些启发式理由对远期未来在天文学上主导短期的观点持怀疑态度。这篇文章聚焦于我认为可能是最强有力的具体(而非启发式)论证,即为什么短期影响可能比天真假设的要重要得多。特别是,有相当大的可能性,我们大多数副本存在于超级智能文明运行的相对短暂的模拟中,如果是这样,当我们在短期内采取行动帮助他人时,我们的善行会被复制多次。值得注意的是,即使只有很小的可能性Nick Bostrom的基本模拟论证是正确的,这种推理也会大大提高短期善行的相对重要性。

我的论点并不能证明针对短期的善举比针对远期未来的更重要,事实上,一个合理的粗略计算表明,针对远期未来仍然比短期的善举重要几个数量级。但我的论证确实为短期与远期问题创造了更多不确定性,并强调了对这个问题进行进一步研究的价值。

目录

介绍

有效利他主义社区内广为接受但在更大范围内罕见的一个观点是,我们行为的远期影响极为重要。当然,许多环保主义者关心地球的未来,过去几代人也开始了在他们有生之年无法完成的项目。但是,在一线的利他主义者中,而不仅仅是科幻作家和宇宙学家,考虑他们的行为对数十亿年后存在的有情众生的影响是很少见的。

关注未来极其重要,但有时可能被夸大。有时人们认为,远期未来如此重要,以至于我们当前行为对当今生物福祉的短期影响完全可以忽略不计,除了短期行为影响远期结果的工具性原因。我称之为"远期未来狂热",类比于Nick Bostrom在"无限伦理学"(第4.3节)中讨论的"狂热问题"。我可能在~2006年到~2013年间相信类似的观点。

然而,就像生活中几乎所有其他事情一样,完整的图景更加复杂。我们应该对任何简单的论证保持极度怀疑,这种论证声称一个行动比另一个行动重要1030倍,例如,影响远期未来比影响近期重要1030倍。也许这是真的,但现实往往是复杂的,这种非凡的主张不应该被轻易接受。这是几个原因之一,我们应该对致力于影响远期未来是否远比改善当前的生命福祉更好保持谦逊。

反勒索方法

Dylan Matthews和许多其他人一样,表达了对远期未来狂热的怀疑,理由是它听起来像帕斯卡勒索。我认为远期未来狂热是一种相当温和的(无勒索者)帕斯卡勒索形式,因为未来狂热者的主张在先验上比帕斯卡勒索者的主张要合理得多。尽管如此,帕斯卡勒索有程度之分,从一个实例中得到的教训应该可以转移到其他实例。1

汉森式杠杆惩罚

原始帖子中最受欢迎的帕斯卡勒索解决方案是Robin Hanson提出的:"人们一直在谈论假设伤害许多人的状态具有低(先验)概率。也许更有希望的是假设伤害许多人的状态与任何随机人声称能够影响的事物具有低相关性。"

ArisKatsaris 将Hanson的想法概括为"可见影响定律":"对于那些论证存在高影响事件但其后果仍然未被观察到的假设,惩罚其先验概率。"

Eliezer Yudkowsky 称之为"杠杆惩罚"。然而,他继续展示了如何对帮助,比如说,一个googolplex人的可能性施加杠杆惩罚可能会导致你不相信你可能产生巨大影响的情景,无论你有多少证据,这似乎可能是错误的。

模拟论证

在这篇文章中,我不依赖于一般的汉森式杠杆惩罚。相反,我使用模拟论证,它在效果上类似于汉森式杠杆惩罚,但它是有机产生的,而不是强制性的。

Yudkowsky 说:"从概念上讲,汉森式杠杆惩罚根本不与模拟假说(Simulation Hypothesis, SH)相互作用。"然而,这两个想法的作用类似,并且有历史联系。事实上,Yudkowsky在听到Hanson的想法后讨论了类似于模拟论证解决帕斯卡勒索的东西:

是的,如果你有3↑↑↑↑3个人在四处奔波,他们不可能都单独控制彼此的存在。所以在一个存在大量人的场景中,必须按比例因子惩罚任何一个人的二元决定可以单独控制整个群体的概率。

即使矩阵声称者说创造的3↑↑↑↑3个心灵与你不同,有信息告诉他们他们是无能为力的,如果你处于一个普遍的场景中,任何人都有并使用这种力量,绝大多数心灵实例都在叶子上而不是根上。

我理解Yudkowsky的观点是,如果宇宙足够大到包含3↑↑↑↑3个人,那么对于每一个被真正的勒索者控制3↑↑↑↑3个人的人,可能还有天文数字的其他人面对撒谎的勒索者、恶作剧、幻觉、梦境等。因此,在整个多重宇宙中,几乎所有被帕斯卡勒索的人实际上都无法拯救3↑↑↑↑3个人,事实上,被假帕斯卡勒索的人数与3↑↑↑↑3成正比。因此,实际上能够帮助N个人的概率大约是k/N,其中k是某个常数,所以无论N有多大,屈服于勒索的期望值都保持有限。

然而,这种推理也适用于Yudkowsky的"帕斯卡的麻瓜"场景,其中一个矩阵领主"在天空中打开一个火热的传送门"来说服一个人,矩阵领主关于以5美元拯救一个googolplex生命的交易是真实的。但是考虑到矩阵领主的宇宙中有大量的计算能力,对于每一个让单个人决定一个googolplex人命运的矩阵领主,可能有大量的矩阵领主只是在假装(无论是为了好玩、测试模拟软件,还是出于其他原因)。因此,面对撒谎的矩阵领主的人的预期副本数量应该与googolplex成正比,因此,汉森先验建议的概率惩罚似乎大致得到了证实。Yudkowsky做了类似的观点:

当涉及到1/3↑↑↑3数量级的不可能性时,先验不可能性是不可避免的 - 你的感官体验不可能如此独特 - 这被认为是适当的,因为几乎每个相信自己能够帮助3↑↑↑3其他人的人实际上都在产生幻觉。玻尔兹曼大脑应该比处于独特位置影响3↑↑↑3其他人的人要常见得多,至少如果因果图是有限的。

依赖观察者?

ArisKatsaris 抱怨说,Hanson的原则"似乎将'人'的概念视为本体论上的基本概念",就像Nick Bostrom式人类学推理的其他实例一样。但是,通过模拟论证方法,你可以避免这个问题,只谈论你自己的精确副本,其中"副本"意味着"其高级决策算法与你自己完全一致的物理结构,因此它决定做什么,你也决定做什么"。副本不需要(通常也不会)共享你的完整环境,只需共享你当前的感官输入和行为输出一段(可能很短的)时间。那么Yudkowsky的论点是,你的几乎所有副本都面对假的或想象的勒索者。

应用于未来狂热

我们可以将模拟反勒索论证应用于未来狂热。我们不是在3↑↑↑↑3人中唯一控制勒索者行为的人,而是在未来几个世纪地球上的数百亿人中,可能是唯一控制地球起源智能的远期未来的人,这可能涉及~1052人,使用Matthews文章中引用的Bostrom估计。对于每一个真实地球上的生物人类,可能有大量模拟地球上的模拟人类,所以我们的大多数副本可能"在叶子上而不是根上",用Yudkowsky的术语来说。

即使地球起源的智能不运行祖先模拟,其他文明可能会运行模拟,比如在研究各种行星上生命起源时,我们可能存在于其中一些模拟中。这类似于即使真正的帕斯卡勒索者可能指定她将创造的所有3↑↑↑↑3个人永远不会认为他们正在被帕斯卡勒索,但在更大的多重宇宙中,应该有更多处于各种其他情况下被假帕斯卡勒索的人。

Yudkowsky 承认模拟可能性及其对未来狂热的影响:

如果我们不把一切都当作表面价值,那么可能存在祖先模拟,你环顾房间的经历可能在1020个祖先模拟中发生一次,而在"基础层面"现实中只发生一次。在这种情况下,你对未来的可能影响力被稀释了(尽管稀释后可能仍然很大)。

如果我们把自己看作你所有的副本而不是特定的细胞或晶体管簇,那么模拟假说并不会降低我们的可能影响力,而实际上会增加它,特别是短期行动的影响力,这将在下面讨论。

模拟论证提高了短期善举的相对重要性

我最初开始思考这个话题是因为Pablo Stafforini的一篇帖子:

如果你认为后人类会运行祖先模拟[...],那么人类灭绝的前景就没有你想象的那么严重。

由于我是一个负向功利主义者,我可能会更倾向于不殖民太空,但Stafforini的观点也与减少远期未来的糟糕程度的努力有关,而不仅仅是防止人类灭绝的努力。

Robin Hanson 做出了类似的观点:

如果不是很多模拟持续整个人类历史,那么你的世界很快就会结束的可能性比你不生活在模拟中时更高。因此,在其他条件相同的情况下,你应该更少关心你自己和人类的未来,更多地为今天而活。即使你非常不确定典型模拟持续多长时间,这仍然是正确的。

一个回应是接受模拟子弹并只关注我们实际上处于基础级现实的情况,因为如果我们是,我们仍然可以产生巨大影响:"Michael Vassar - 如果你认为你是拿破仑,而所有这样想的人都在精神病院里,你仍然应该表现得像拿破仑,因为如果你是,你的行为就很重要。"

第二个回应是意识到专注于短期帮助的行动可能比未来狂热者认为的相对更重要。大多数模拟可能是短暂的,因为用相同的计算资源可以运行大量短暂的模拟,而不是单个长期模拟。Hedonic Treader:"一般来说,如果你有证据表明你的现实可能比你想象的更短暂,这是一个很好的理由来偏好近期未来而不是远期未来。"

模拟论证在多大程度上减少了未来狂热

注:本节是这里写的论证的更详细版本。读者可能会发现那里的计算表述更简单。

本节提出了一个简化的框架,用于估计考虑模拟论证后短期与远期行动的相对重要性。一个针对短期影响的行动示例是改变地球上的生态系统以减少野生动物的痛苦,比如将草坪改造成砾石。一个针对远期未来的行动示例是传播这样的观点:运行详细的生态系统模拟(无论是出于科学、娱乐还是深度生态学的原因)是错误的,因为它们会包含野生动物的痛苦。当然,这两种行动都会影响短期和远期,但为了这个分析的目的,我会假装砾石草坪只能防止虫子在短期内受苦,而反自然模拟的观点传播只能帮助防止虫子在长期内受苦。我试图只关注目标影响的时间范围,但当然,在现实中,即使未来狂热者是对的,每个短期行动都有远期影响,所以没有慈善机构比另一个重要1030倍。

我会假设远期未来的大部分痛苦将由先进文明运行的计算创造。我不会用FLOPS或其他传统性能指标来衡量计算能力,而是用它们包含的感知程度来衡量,以被计算的代理和子程序的形式,测量单位我称之为"感知"。我将"感知"定义为"心理生活的道德相关复杂性"。我计算一个代理体验情感的道德价值(或负价值)为

道德价值 = (代理的感知) * (代理会判断情感相对于其进化/生理典型情感的强度) * (体验的持续时间)。

例如,如果一个人类的感知为1感知,一只苍蝇的感知为0.01感知,那么即使苍蝇相对于其效用函数经历了更具破坏性的事件,该事件可能获得更少的道德权重。

使用感知单位将有助于使后续计算更容易。我将1感知年定义为一个典型生物人类一年经历的复杂性加权体验量。也就是说,考虑地球上现在的中位数生物人类在一年中经历的感知。那么,一个主观体验是这46倍的计算过程有46感知年的计算。2

假设有一个大但有限的数量C的文明即将殖民太空。(如果有人坚持宇宙是无限的,可以将分析限制在宇宙的一个巨大但有限的子集中,以避免无穷大破坏数学。)平均而言,这些文明将运行感知等同于N人年的计算,即N感知年的计算能力。所以这些文明总共创造了相当于C * N感知年。

这些心灵中的一些可能是由想要通过将(自己的副本)沉浸在体验机器或虚拟世界中来感受强烈情感的代理创造的。此外,我们对编程的数字代理的体验有更大的控制,而不是对当今的生物生物。3这些因素表明,影响未来人类经历的一年可能比影响当今人类经历的一年在利他主义上重要得多。未来的模拟人类每单位时间可能有更高的体验强度,我们可能对他的体验质量有更大的控制。让乘数T代表影响平均未来数字代理的一单位感知比影响当今生物代理的一单位感知重要多少倍。T将以每感知年的道德(负)价值为单位。如果认为相当一部分后人类模拟将出于电线头或内在地重视强烈体验的原因而运行,那么T可能远大于1,而如果认为大多数模拟将出于科学/历史发现的目的而运行,那么T将更接近1。T还计入非模拟主观体验的强度和可控性。如果远期未来的大部分主观体验来自具有相当非强烈体验的低级子程序,那么T可能更接近1。

假设地球上近期(比如说,未来一两个世纪)的感知量是某个数量E感知年。假设这种感知的一部分fE以人类心灵的形式存在,其余的是动物、其他生命形式、计算机等。

一些远期未来的模拟可能只包含一个在其他方面肤浅的世界中精细计算的心灵。我将这些称为"唯我论模拟"。许多其他模拟可能包含几个模拟人在非常有限的区域内短时间互动。我会创造形容词"类唯我论"来指这些模拟,因为它们不完全是唯我论的,但因为它们只有很少的人,所以它们是唯我论式的。Robin Hanson 描绘了类唯我论模拟的以下画面:

例如,考虑一个千禧年转折点的派对的计算机模拟,创建它是为了让特定的未来客人参与。这个模拟可能计划只持续一个晚上,一开始仅限于派对大楼里的人,也许还有从那栋楼可以看到的几个人。如果未来客人决定离开派对在城市里漫步,派对上的模拟人可能会被删除,取而代之的是模拟的人口,他们居住在派对参与者走过的街道上。

相比之下,非类唯我论模拟是指大多数或所有看似存在于地球上的人和动物实际上都被模拟到了非平凡的细节水平。(无生命物质和外层空间可能仍然以较低的丰富度被模拟。)

让fN是先进文明运行的非类唯我论模拟中认为自己是地球上人类的计算所占的比例,其中计算以感知年为单位测量,即fN = (所有认为自己是地球上人类的非类唯我论模拟的感知年)/(总共运行的所有计算的感知年)。让fC是C个文明中实际上作为地球上的生物人类开始的比例(而不是生物外星人)。

使用Bostrom式人类学和因果决策理论的计算

我和大多数MIRI研究人员已经不再使用Bostrom式人类学推理,但Bostrom人类学在学术文献中仍然广为人知,并且在许多应用中很有用,所以我首先探讨这个框架下模拟论证的含义。特别是,我将使用自我抽样假设,参考类是"认为自己在殖民前地球上的人类"。这样的人类总数是实际上是地球上生物有机体的人的组合:

(真实地球数量) * (每个真实地球上的人类感知年) = (C * fC) * (E * fE)

和那些在模拟中认为自己在地球上的人:

(先进文明计算数量) * (由认为自己在地球上的非类唯我论人类组成的比例) = C * N * fN。

请注意,Bostrom的强自我抽样假设是从观察者时刻中随机抽样,而不是从感知年中抽样,但假设所有人类基本上有相同的感知,那么从感知年中抽样应该给出与从观察者时刻中抽样基本相同的结果。

Bostrom的模拟论证三难推理的第三个角可以通过注意到,只要N/E非常大(拒绝第一个角)且fN / (fC * fE)不是相应地极小(拒绝第二个角),模拟人类与生物人类的比例将会非常大:

(非类唯我论模拟人类感知年) / (生物人类感知年)

= (C * N * fN) / (C * fC * E * fE)

= (N/E) * fN / (fC * fE)。

如果你从所有(非类唯我论)模拟+生物人类感知年中随机抽样,你是生物人类的概率Pb是

Pb = (生物人类感知年) / [(模拟人类感知年) + (生物人类感知年)] = (C * fC * E * fE) / [(C * N * fN) + (C * fC * E * fE)] = (fC * E * fE) / [(N * fN) + (fC * E * fE)]。

如果我们是生物人类,那么我们就处于可以影响我们未来所有N个预期感知年计算的位置,这些计算将平均具有T倍的强度和可控性(以每感知年的道德价值单位)。另一方面,可靠地影响远期未来要困难得多,因为有太多未知因素和太多介入步骤在我们现在做的事和几个世纪或千亿年后发生的事之间的因果链中。让D代表一个折扣,表示由于不确定性和我们现在的行动对后来发生的事情的影响被削弱,实际上帮助远期未来的一个生命比帮助近期的一个生命要困难多少。

如果我们是生物人类,那么针对远期未来可以影响N个预期感知年,强度倍数为T,但有折扣D,预期影响与N * T * D成正比。4另一方面,如果我们针对短期,我们可以帮助目前地球上的感知,影响与E成正比。5

然而,针对远期未来的行动只有在存在远期未来时才重要。在大多数模拟中,未来不会延伸很远,因为模拟一个长期的后人类文明在计算上会极其昂贵。例如,在模拟中模拟一个行星大小的计算机可能至少需要一个行星大小的计算机来运行模拟。作为一种近似,让我们假设针对远期未来影响的行动只有在我们是真实地球上的生物人类时才重要。那么远期未来行动的预期影响与Pb * N * T * D成正比。让我们称这个量为"L",代表"长期影响"。相比之下,针对短期的行动无论我们是被模拟还是不是都会产生影响,只要模拟至少运行几十年并包括地球上的大多数动物。所以短期行动的预期影响就是E。让我们称我们对短期行动的预期影响为S。

这两个量的比率是L / S = Pb * N * T * D / E。

一个简单的例子

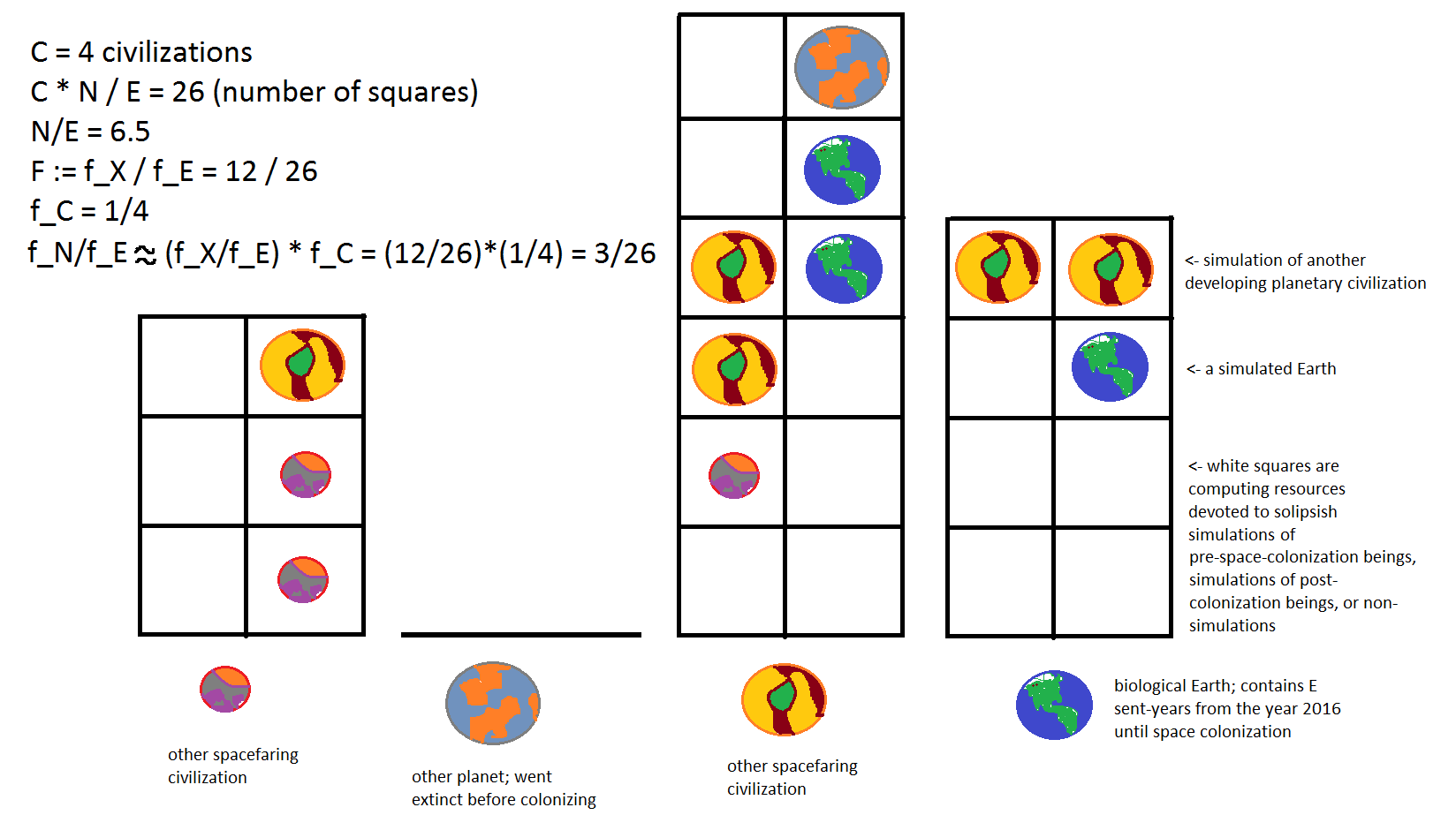

下图显示了我在这里使用的框架的卡通示例。我还没有定义你在左上角看到的所有变量,但它们很快就会解释。

注意N = 6.5 * E且fN = (3/26) * fE。通过检查图片,我们可以看到Pb应该是1/4,因为有一个真实的地球和三个模拟版本。如我们所希望的,我们对Pb的公式验证了这一点:

Pb = (fC * E * fE) / [(N * fN) + (fC * E * fE)] = (1/4 * E * fE) / [(6.5 * E * 3/26 * fE) + (1/4 * E * fE)] = (1/4) / [(6.5 * 3/26) + (1/4)] = 1/4。

而L / S = Pb * N * T * D / E = (1/4) * 6.5 * T * D = 1.6 * T * D。

请注意,在实际图片中,地球在未来有8个计算方块,但N/E只有6.5。这是因为N/E是跨文明的平均值,包括一些在殖民太空之前就灭绝的文明。但这样的平均值似乎适合我们的情况,因为我们事先不知道人类是否会灭绝,也不知道人类的计算资源与其他文明相比会有多大。

基于你所有副本的计算

现在我将重新进行计算,使用一个不依赖于自我抽样假设的框架。相反,它从人类决策理论中获得灵感。你应该把自己看作你所有的副本。你不应该认为你是你的某个可能是生物的或可能是模拟的副本,而应该认为你既是生物又是模拟的,因为你的选择影响你的生物和模拟副本。有趣的问题是你的模拟副本与生物副本的比例是多少。

当存在更多地球副本(无论是生物还是模拟)时,你就会有更多副本。特别是,假设所有非类唯我论人类感知年(无论是生物还是模拟)中有一个常数比例fy是你的副本。这通常应该大致成立,因为2016年地球的非类唯我论模拟应该有~70亿人,其中一个是你。

那么你的生物副本(实际上是副本生命年)的预期数量将是fy * C * fC * E * fE,模拟副本生命年的预期数量将是fy * C * N * fN。6

现在假设你采取行动改善远期未来。你所有的副本,无论是模拟的还是生物的,都会采取这个行动,尽管它只对生物副本有影响,因为只有它们有很长的未来。对于每个生物副本,该行动的预期价值与N * T * D成正比,如前一小节所讨论的。所以让你所有副本采取针对远期未来的行动的总价值与

L = (你的生物副本数量) * (每个副本的预期价值) = (fy * C * fC * E * fE) * (N * T * D)成正比。

相比之下,考虑采取行动在短期内帮助。无论你是生物的还是非类唯我论模拟的,这都会有帮助。该行动对每个副本的预期价值与E成正比,所以跨所有副本的总价值与

S = (你的生物+非类唯我论模拟副本数量) * (每个副本的预期价值) = (fy * C * fC * E * fE + fy * C * N * fN) * E成正比。

那么我们有

L / S = [ (fy * C * fC * E * fE) * (N * T * D) ] / [ (fy * C * fC * E * fE + fy * C * N * fN) * E ]。

有趣的是,这恰好等于Pb * N * T * D / E,与我们使用自我抽样假设计算的远期未来vs短期预期价值的相同比率。

简化L/S

简化上面的L/S表达式:

L/S = [N * T * D / E] * (fC * E * fE) / [(fC * E * fE) + (N * fN)] = T * D * fC / (fC * E/N + fN/fE)。

注意,这个比率严格小于T * D * fC / (fN/fE),这是一个不依赖于N的量。因此,我们不能仅仅通过使N任意大来使L/S任意大。

让fX是超级智能计算中用于非类唯我论模拟任何实际以生物形式存在的几乎太空殖民文明发展的平均比例,不仅仅是地球上的人类。fN是用于模拟特别是地球上人类的计算比例。如果我们做一个简化假设,即所有超级智能集合用于模拟地球上人类的模拟比例将与宇宙中所有文明中人类的比例成正比,那么fN = fX * fC。如果

- 所有文明都按其数量比例运行所有其他文明的模拟

- 只有人类后代(而不是外星人)只运行地球上人类(而不是外星人)的模拟,并且有典型数量的计算能力用于此类模拟,或者

- 介于这两个极端之间的各种组合是真实的,

那么这将是正确的。

做出这个假设,我们有

L/S = T * D * fC / (fC * E/N + fX * fC/fE)

= T * D / (E/N + fX/fE)。

几乎太空殖民行星上主导智能的非类唯我论模拟也包括同一行星上的(地球或外星)野生动物。假设典型的几乎太空殖民行星上(主导智能生物感知年)/(所有生物感知年)的比率大约是fE,那么fX / fE大约等于所有计算感知年中用于非类唯我论模拟几乎太空殖民祖先行星(包括最智能和较不智能的生物)的比例。我将这个比例简单地称为F。那么

L/S = T * D / (E/N + F)。

用之前的图片来可视化,fN/fE是有地球的方块的比例,F是有任何行星的方块的比例。

每个人都同意E/N非常小,可能小于10-30或类似的数字,因为远期未来可能包含天文数量的感知。如果F不是几乎同样小(我猜测它不是),那么我们可以近似L/S为T * D / F。

代入参数值

现在我们有了L/S的表达式,我们想知道它是否远大于1(在这种情况下,远期未来狂热者是对的),远小于1(在这种情况下,我们可能应该帮助短期内的生命),或者在1附近的某个地方(在这种情况下,问题不清楚,需要更多调查)。为此,我们需要插入一些参数。

在这里,我将插入T、D和F的点估计,但这样做并没有考虑它们值的不确定性。从形式上讲,我们应该根据T和D的概率分布取L的完整期望值,并将其除以根据F的概率分布取的S的完整期望值。我避免这样做是因为为这些变量创建完整的概率分布很复杂,但我试图将我的点估计设置得更接近变量的期望值而不是中位数值。我们对T、D和F的中位数估计可能与期望值相当不同,因为极端值可能主导期望值计算。出于这个原因,我通常将参数点估计设置得比我实际认为合理的中位数估计要高。当然,你自己的估计可能会有很大不同。

D = 10-3

这是因为(a)很难知道现在的给定行动是否真的会在长期内产生好的影响,比知道给定行动是否会在短期内产生好的影响要难,以及(b)虽然发达世界的单个利他主义者可以对地球上现在所有的感知施加超过~1/(70亿)的影响(比如通过改变存在的荒野数量),但单个人可能对远期未来的感知施加的影响不到那么多,因为在我们之后会有几代人,他们可能有不同的价值观,可能会推翻我们的决定。

特别是,对于点(a),我假设~0.1的概率折扣,因为例如,虽然不是不可能以75%的信心确定某个行动会减少短期野生动物数量(有25%的机会增加它们,给出50%的概率折扣),但在许多远期未来问题上,我对产生积极而不是消极影响的信心更像是53%(对于6%的概率折扣,这大约是50%的10倍小)。

对于点(b),我使用~0.01的概率折扣,因为在人工通用智能(AGI)出现之前可能还有几代人,即使AGI到来,也不清楚之前人类的价值观是否会转化为AGI的价值观,AGI是否会在没有进一步变异这些价值观的情况下实现目标保存。也许目标保存很难实现或在与外星人的自我改进竞赛中在战略上不受青睐,因此我们现在努力改变AGI的价值观和轨迹将在数千或数百万年后被推翻。(不考虑防止人类灭绝为重要的非负面功利主义者在这里可能不会打这么多折扣,因为防止灭绝不像试图改变未来的价值观或一般轨迹那样存在相同的目标/制度/社会漂移风险。)

T = 104

超级智能运行的一些模拟可能会有极其强烈的情感,但许多(特别是那些为了科学准确性而运行的)不会。即使只有预期0.01%的远期未来感知年由比地球上平均体验强烈108倍的模拟组成,我们仍然会有T ≈ 104。

F = 10-6

超级智能会运行多少几乎太空殖民行星的模拟是非常不清楚的。用于此目的的所有计算资源的比例可能接近100%,也可能低于10-15。很难预测先进文明的资源分配。但我设置这个参数是基于假设~10-4的感知年将用于某种祖先模拟(这可能太高了,但在期望上是有偏的,因为,例如,也许有0.05%的机会后人类将20%的感知年用于祖先模拟),而只有1%的这些模拟将是几乎太空殖民时期的(因为可能还有许多生命起源、史前和行星"奇点"后早期的模拟)。如果我们认为模拟每单位计算包含比其他数字运算更多的感知,那么10-4的感知年用于某种祖先模拟可能意味着用于此类模拟的原始petaflops少于10-4。

使用点估计的计算

使用这些输入,我们有

L/S ≈ T * D / F = 104 * 10-3 / 10-6 = 107。

这恰好大于1,这表明针对远期未来仍然比针对短期好~1000万倍。但使用其他可能的输入,这个计算可能会得出小于1的结果。结合一般的模型不确定性,似乎过早得出远期未来关注的行动主导短期帮助的结论。在更彻底的分析之后,远期未来可能仍然会占主导地位,但程度远低于天真的未来狂热者所认为的。

反对意见

这是否假设模拟假说有99.999999%的可能性是正确的?

不是。只要你保持至少一个适度的概率(比如说,至少1%或0.01%)模拟假说是正确的,我的论点就成立。

如果完全拒绝几乎太空殖民文明的模拟可能性,那么F = 0。在这种情况下,L/S = T * D / (E/N + F) = T * D * N / E,这将是天文数字般巨大,因为N/E是天文数字般巨大。所以如果我们确定F = 0(或者即使F仅仅是E/N量级的大小),那么我们就会回到未来狂热。但我们并不确定这一点,如果F > 0,我们的影响并不变得无关紧要。事实上,我们的模拟副本越多,我们通过短期针对行动产生的影响就越大!

让我们称F在E/N量级或更小的情况为"tiny_F"可能性,F远大于E/N的情况为"moderate_F"可能性。S的期望值,E[S],是

E[S | tiny_F] * P(tiny_F) + E[S | moderate_F] * P(moderate_F)

L的期望值也是如此。虽然E[S | tiny_F]确实很小,因为在这种情况下我们在模拟中没有很多副本,但E[S | moderate_F]更大。事实上,

E[L] / E[S] = E[L] / { E[S | tiny_F] * P(tiny_F) + E[S | moderate_F] * P(moderate_F) }

≤ E[L] / { E[S | moderate_F] * P(moderate_F) }

≈ E[L | moderate_F] / { E[S | moderate_F] * P(moderate_F) },

其中最后一行假设L不会因F的值而大幅变化。这最后一个表达式非常粗略地类似于(L/S) / P(moderate_F),其中L/S是通过插入一些适度的F值计算的,就像我用我的样本数字做的那样。所以除非你认为P(moderate_F)极小,否则考虑到没有模拟的可能性,总体E[L]/E[S]比不会发生戏剧性变化。

我听到过以下对未来狂热主义的辩护,以对抗模拟:

- 由于模型不确定性,我不在模拟中的概率是非零的。

- 因此,我通过远期未来努力产生天文影响的概率是非零的。

- 但我不能通过短期努力产生天文影响。

- 所以远期未来在期望上占主导地位。

如果你只考虑自己是你的副本中的单个副本,这个回应可能有效。但如果你正确地意识到你的认知算法共同决定了你所有副本的选择,那么短期关注的努力不会产生天文影响就不再是真的了,因为在期望上,你有天文数量的模拟副本,在这些副本中你的善行会被复制。

如果几乎所有文明在太空殖民之前就灭绝了怎么办?

这个反对意见表明Bostrom三难推理的第一个角可能是正确的。如果几乎所有技术文明都未能殖民太空 - 无论是因为它们自我毁灭还是因为太空殖民由于某种原因被证明是不可行的 - 这确实会大大减少运行的先进计算数量,即N会相当小。

我认为这种可能性不太可能,因为很难想象为什么基本上所有文明都会自我毁灭,考虑到人类似乎有相当好的机会殖民太空。也许更有可能的是存在物理/技术限制,限制了大规模太空殖民。

但如果是这样,那么远期未来可能比看起来重要得多,要么是因为人类很快就会灭绝,要么是因为即使人类确实存活下来,他们也不会创造天文数量的数字心灵。这两种可能性都降低了未来狂热主义。也许如果人类在地球上再存活~1亿年,远期未来可能比现在重要得多,但没有人工通用智能和强大的目标保存,似乎更难确保我们现在所做的事情会对数百万年后产生可靠的影响(除了少数领域,也许影响二氧化碳排放)。

如果大多数模拟都是长寿的怎么办?

在前面的论证中,我假设生活在模拟中的我们的副本没有远期未来,因为它们的模拟可能会在几十年、几个世纪或几千年内结束。但如果模拟是非常长寿的呢?

模拟不太可能像基础级文明那样长寿,因为在模拟中模拟X数量的计算可能需要超过X个基础计算。但我们仍然可以想象,例如,2个模拟,每个都是基础现实的1/5大。那么在这些模拟中瞄准远期未来影响仍然会相当重要,因为我们在模拟中的副本会影响2个远期未来,每个都有基础远期未来1/5的长度。

请注意,我的论证形式已经考虑到了这种可能性。F是远期未来计算中用于模拟几乎太空殖民行星的比例。远期未来的大部分不是在几乎太空殖民阶段,而是在太空殖民阶段,所以模拟远期未来结果的大多数计算不计入F。例如,假设有一个基础现实模拟2个远期未来模拟,每个运行基础宇宙运行时间的1/5。假设在这些模拟中,前太空殖民行星只占所有感知的10-20。忽略也在运行的非模拟计算,这意味着F = 10-20,这非常接近0。所以模拟可能很长寿的反对意见可以归结为F可能极接近零的反对意见,我之前讨论过。一般的回应是,认为F如此接近零似乎不合理,F可能要大得多(例如,10-10、10-5或类似的数字)是相当可能的。如果F更大,短期影响会被复制得更频繁,因此相对更重要。

我预计模拟长度的分布可能遵循幂律。如果我们看看在现代计算机上运行的线程/进程的长度分布,或公司存活多长时间,或几乎任何类似的东西,我们往往会发现很多短寿的东西和少数长寿的东西。我预计模拟也会类似。在整个多元宇宙的所有超级智能中,认为很少运行短期模拟而大多数模拟都是长期的,这似乎是不合理的。

另一个考虑因素是,如果模拟者知道他们想要测试的初始条件,那么让模拟运行更长时间可能意味着它随着时间的推移越来越偏离现实,因为错误会累积。

此外,如果存在长期模拟,它们本身可能会运行模拟,然后我们可能在那些嵌套模拟中有短期副本。随着模拟嵌套级别的增加,嵌套模拟的长度(和/或计算复杂性)必须下降,因为可用的计算能力越来越少(就像最内层的俄罗斯套娃可用空间越来越少一样)。

如果远期未来被模拟,而嵌套模拟的数量和/或复杂性随着嵌套级别的增加没有逐步减少,那么在模拟变得可行之后运行模拟将需要计算能力的爆炸性增长:

模拟的创造者可能不会继续运行模拟超过历史上首次开发和广泛运行这些模拟的技术的时间点。[...]另一个原因是避免模拟堆叠,即模拟中的模拟,这将不可避免地在某个点上使运行所有模拟的基础机器过载,从而导致所有世界消失。这由麻省理工学院的Seth Lloyd在他最近的书《编程宇宙》中指出的事实说明,如果真实宇宙中的每个基本粒子都用于量子计算,它每秒能够在1092比特的信息上执行10122次运算。在堆叠模拟场景中,其中106个模拟被逐步堆叠,仅16代之后,模拟的数量就会超过真实宇宙中可用于计算的信息比特总数的104倍。

文明几乎准备殖民太空的时期对模拟者来说似乎特别有趣,因为它关键地影响远期未来如何展开。因此,对现在这个时期的模拟可能比对1百万年后的未来的模拟要多,而且21世纪的许多模拟可能相对较短。

除了这些定性论证之外,我们还可以做一个定量论证,说明为什么模拟中的远期未来不应该占主导地位:一个在其远期未来拥有N感知年计算能力的文明不可能产生超过N感知年的模拟远期未来感知,即使它只运行模拟并且没有模拟开销(即,一个行星大小的模拟计算机只需要一个行星大小的真实计算机就可以模拟)。更有可能的是,一个拥有N感知年计算能力的文明可能只会运行大约N/100感知年的模拟远期未来感知,或者类似的数量,因为它可能还想计算模拟以外的东西。所以影响"真实"远期未来的利害关系可能比影响模拟远期未来的利害关系要大得多。(当然,如果我们存在于外星人的模拟中,而不仅仅是我们自己文明的模拟中,模拟的远期未来可能会更大。但除非我们特别是极其受欢迎的模拟目标,这似乎先验上不太可能,那么一般来说,在整个多重宇宙中,我们控制的模拟远期未来的总和应该小于我们控制的真实远期未来的总和。)当然,类似的观点也适用于短期未来的模拟:我们控制的所有短期未来的总感知年很可能少于我们控制的远期未来的总感知年(假设我们在模拟和基础现实中都有副本)。短期帮助可能潜在地胜过长期帮助的论点来自于我们更有能力影响短期,并且知道我们正在产生积极而不是消极的短期影响。如果没有针对远期未来行动的D概率惩罚,在我的框架内很明显L > S。

如果基础宇宙有无限的计算能力怎么办?

如果基础宇宙有无限的计算能力,因此对模拟可以持续多长时间没有限制怎么办?如果模拟运行得极快,以至于没有理由不运行一个完整的模拟宇宙从大爆炸到恒星死亡怎么办?即使这样,对我来说也不清楚我们是否不会主要得到短期模拟,特别是如果它们是出于内在价值的原因而运行的。对于每一个长期模拟,可能有数百万或数万亿个短期模拟。

然而,有人可能会争辩说,如果基础级模拟者只对科学感兴趣,那么他们可能不会运行短期模拟(除了测试他们的模拟软件时),而只是运行一堆长期模拟,然后在任何给定时间查看长期模拟的任何部分。事实上,他们可能会运行所有可能的具有我们物理定律的宇宙历史,一旦这个完整的集合对他们可用,他们就不需要再运行任何具有我们物理定律的宇宙的模拟。不用说,这种可能性是极其推测性的。也许有人会争辩说,这也极其重要,因为如果这种情况是真的,那么就有天文数量的我们的副本。但有各种各样的随机场景,人们可以提高赌注,试图使一些模糊的可能性占主导地位。毕竟,这就是原始帕斯卡勒索思想实验的重点。相比之下,我不认为我在这篇文章中提出的基于模拟的论证是帕斯卡勒索的一个强烈实例,因为先进文明运行大量地球人模拟似乎相当可能。

无论如何,即使基础宇宙确实有无限的计算资源并且已经运行了我们宇宙所有可能历史的模拟,这也不能逃脱我的论证。基础运行的模拟会是长期的,是的。但这些模拟可能会包含嵌套模拟,因为这些模拟中的先进文明可能想要运行自己的模拟。因此,我们的大多数副本可能生活在嵌套模拟(即模拟中的模拟)中,这篇文章中的论证会像以前一样进行。基础模拟者将仅仅像自然神论的神一样,设定我们的宇宙运转,然后让它无限期地自行运行。

我们的模拟副本仍然可以通过帮助我们的模拟者来影响遥远的未来

即使你的一个副本生活在一个短期模拟中,它也可能对模拟之外产生因果影响。许多模拟可能是出于科学发现的原因而运行的,通过在我们的世界中学习东西,我们可能告知我们的模拟者这些东西,从而产生巨大影响。

我认为这是一个薄弱的论点,原因有几个。

- 如果模拟者想了解宇宙的一般情况,他们可能会更成功地使用人工通用智能来做到这一点,而不是创造充满灵长类动物的假世界,其中只有一小部分人从事科学研究。

- 如果我们只是通过展示文明如何发展来帮助我们的模拟者,那很好,但那么我们就不清楚我们应该基于这种可能性采取任何特定的行动。

- 如果我们只是众多模拟中的一个,我们特定信息对模拟者的影响很小。(比较一个5000人调查中单个回复的价值。)

- 不清楚我们是否想帮助我们的模拟者,因为他们可能有与我们自己相反的价值观。

如果模拟没有意识怎么办?

我非常确信我会关心模拟人类。如果你认为你不会,那么你也不太可能关心远期未来,因为在许多远期未来场景中,特别是那些包含最多有情众生的场景中,大多数智能是数字的(或者至少是非生物的;它可能是模拟计算的)。

如果你认为模拟是否有意识是一个事实而不是道德问题,那么你应该保持一些不太小的概率,认为模拟是有意识的,并相应地降低你的副本在模拟中可能产生的影响。只要你对模拟有意识的概率不是微小的,这不应该改变分析太多。

如果你对模拟是否重要有道德上的不确定性,两信封问题会来困扰你。但你的道德议会中关心模拟的派系应该对你如何选择行动有一些影响,这似乎是合理的。

模拟论证很奇怪

在一篇帖子中为远期未来的巨大重要性辩护时,steven0461预见到了本文讨论的论点:

我们生活在祖先模拟中的想法。这将意味着天文浪费是虚幻的:毕竟,如果大部分天文资源都用于此类模拟,每个模拟都只能决定发生在资源上的一小部分。这将限制回报。看到更多关于给定我们在模拟中的最佳慈善分析会很有趣,但似乎不应该把一个人的情况建立在那个假设上。

但我认为我们应该将模拟考虑作为整体分析的一个强有力的组成部分。当然,它们很奇怪,但认为我们可以某种程度上可靠地影响后人类超级智能的处女座超星系大小的计算也很奇怪,这是更有说服力的未来狂热形式所依赖的框架。

由于更大的Kolmogorov惩罚,模拟人的重要性较低

这个反对意见很深奥,但有人向我提到过一次。有人提出,应该按照在多重宇宙中定位该代理的Kolmogorov复杂度的比例来衡量代理的道德价值。例如,在地球上定位一个生物人类可能比在大量后人类模拟的数组中定位该人类的任何特定副本更容易。生物人类可能被指定为"自公元0年以来人类称之为公元0年的那一年出生的第10,481,284,089个人类,在开始后人类文明的行星上",而该人类的模拟版本可能是"在行星#5,381,320,108上,在隔间#82,201中,在模拟#861中,自模拟人类称之为公元0年的那一年以来出生的第10,481,284,089个人类"。(这些只是这一点的粗略说明。实际描述需要更大的精确度。而且不完全清楚我用文本写的一些想法是否可以简洁地指定。)可以定位模拟人的最短程序,可能比可以定位生物人的最短程序要长,所以模拟人(以及可能他模拟世界中的其他生物)获得较少的道德权重。因此,由于所有该人副本的相关行为而产生的短期帮助的天文价值低于看起来的程度。

然而,以这种方式普遍给予未来生命较低道德权重的观点也应该给予远期未来可能居住的其他类型的有情生物较低的道德权重,特别是那些不够独特以至于无法轻易定位的生物。所以影响远期未来的重要性也被这种道德观点所削弱。这种基于位置惩罚的方法如何影响短期与远期帮助的相对重要性并不明显,需要一些详细计算来评估。

大脑的多个副本并不比一个副本重要得多

earthwormchuck163:"我真的不确定我是否那么在乎重复。"8应用于模拟假说,这表明如果在许多模拟中有许多你的副本帮助其他地球人,由于你和被帮助的地球人在不同的模拟中有相同的大脑状态,那些重复的大脑状态可能不比单个这样的大脑状态重要得多。在这种情况下,你通过短期关注的行动帮助模拟中大量副本的能力就不那么重要了。为了具体说明,想象在1000个模拟中有1000个你和你帮助的人的副本。如果你不认为几个副本在道德上比一个副本重要得多,那么你的短期帮助所做的好事将相对于一个关心每个1000个副本的观点除以1000。

那么针对影响远期未来呢?如果远期未来中所有道德相关的计算都被复制了大约1000次,那么针对影响远期未来的价值也比你单独关心每个副本的情况低大约1000倍。然而,远期未来可能会包含更多的心灵多样性。例如,也许一些文明会明确地致力于使每个后人类心灵在某种程度上是独特的,以避免重复。在这种情况下,如果一个人持有许多心灵副本只与一个心灵一样重要的观点,那么针对远期未来的利他主义可能会显得比短期帮助更有希望。

我的主要回应是,我认为认为大脑的许多副本不比单个大脑重要得多是错误的。这对我来说似乎是直观的,但它得到了Bostrom的归谬法的加强:

如果宇宙确实是无限的,那么根据我们当前最好的物理理论,所有可能的人类大脑状态都会以概率1在某处被实例化,无论我们做什么。但我们肯定应该拒绝这样的观点,即由此可以推断出所有关注我们行为的经验后果的伦理都是无效的,因为我们不能造成痛苦、快乐,或者实际上任何经验。

另一个回应是观察到一个大脑是否算作重复是一个观点问题。如果我在这里的笔记本电脑上运行一段给定的代码,你在世界另一端的笔记本电脑上运行它,这两个软件实例是重复的吗?从高级逻辑行为相同的意义上说是的。从它们在不同的物理块上运行,在不同的时空位置,靠近不同的物理对象的意义上说不是。心灵没有非任意的边界,软件程序的"扩展心灵",包括它运行的笔记本电脑和运行它的用户,在两种情况下并不相同。

最后,大多数模拟可能在低级别上有差异是合理的。两个不同的超级智能文明运行的模拟不太可能在每个模拟神经元或物理对象的层面上完全相同。相反,我推测会有很多模拟细节的随机变化,但假设你的大脑对某个随机神经元在各个时间是否发射有一定的鲁棒性,那么几个略有不同的模拟变体可以有相同的高级输入-输出行为,因此对决策理论目的来说都可以是"你"的副本。在单个超级智能文明运行的模拟中可能也会有变化,因为除了为了调试模拟或复制/验证过去的科学发现之外,没有科学需要重新运行完全相同的历史轨迹的重复模拟,直到每个人中的每个神经元都相同。

当然,也许"许多副本不比一个副本重要得多"的观点会说,近似副本也不比一个副本重要得多。这种观点容易受到潜在的归谬攻击,比如认为如果两个完全相同的双胞胎经历了相同的可怕死亡,这比两个非常不同的人遭受不同但同样可怕的死亡要不那么糟糕。(当然,也许一些哲学家会接受这个结论。)

如果我们被模拟,那么通过防止存在来减少痛苦会释放更多的计算资源

这是一个重要且令人担忧的考虑。例如,假设你的目标是通过减少栖息地从而减少野生动物数量来防止野生动物痛苦。如果模拟包括所有动物神经元的模型,但不会以太多细节模拟无生命物质,那么通过减少野生动物数量,我们会节省计算资源,模拟者可以将这些资源用于其他用途。令人担忧的是,这可能允许模拟者运行更多类似地球行星的总模拟,其中大多数神经元都在无脊椎动物中,这些动物寿命短,可能死得很痛苦。

如果将野生动物减少10%允许模拟者运行10%更多的总地球模拟,那么栖息地减少可能不会减少太多痛苦。9但如果地球模拟的计算能力的相当一部分用于不太有意识的过程,如天气,那么X%的野生动物数量减少会使整个模拟的计算成本减少不到X%。此外,特别是如果模拟是出于科学而不是内在价值的原因而运行的,模拟者可能只需要为他们的目的运行这么多模拟,我们使模拟更便宜不一定会导致模拟者运行更多。10模拟者可能会将这些计算资源用于其他目的。假设这些其他目的平均包含的痛苦比荒野模拟中存在的痛苦少,那么减少栖息地仍然可能相当有价值。

有人可能会问:如果T > 1,那么由于节省栖息地计算而可以以更大数量运行的非地球模拟计算不会有更大的痛苦密度,而不是更小吗?不一定,因为T给出的是每感知年的情感强度。但先进文明运行的许多计算可能不包含太多感知。11所以非地球模拟计算的每petaflop-年情感强度,而不是每感知年,可能低于T。尽管如此,我们应该担心这可能不是真的,在这种情况下,通过减少栖息地从而为我们的模拟者释放计算资源将是净负面的(至少对负面功利主义者来说;对古典功利主义者来说,用可能包含净幸福的其他计算替换包含净痛苦的生态系统可能是双赢)。

也值得问,减少地球上的净初级生产力是否真的会节省模拟者的计算能力。如果模拟运行得足够详细以至于无脊椎动物神经元被近似,那么模拟可能也会以足够的细节运行,以至于,例如,土壤化学、海洋洋流,甚至可能光子也被近似。即使土壤中的蚯蚓和细菌更少,它可能仍然包含同样多的粘土颗粒、水袋和其他需要建模的现象,以使模拟现实。例如,地下水是人类a href="https://en.wikipedia.org/wiki/Hydrogeology">广泛监测的变量,即使地面没有生命,其动态也需要准确建模。尽管如此,构成生物体的大部分干质量来自大气(以二氧化碳的形式),对我来说并不明显,如果它们没有被生物生物捕获,一个准确的地球模拟是否仍然需要模拟单个碳基分子。尽管如此,这些关于非生物环境因素的考虑表明,在准确的模拟中,可能几乎所有的计算都用于非生命物理过程。所以,例如,也许99%的地球模拟中的计算资源用于模拟非生物现象,在这种情况下,将植物生产力减少50%只会将模拟的计算成本减少1% * 50% = 0.5%。这种生物生产力的减少会选择性地减少模拟中最密集痛苦的部分,除非用这些计算节省运行的计算至少包含一些极其强烈的痛苦,否则生物生产力的减少可能在减少痛苦方面仍然是净积极的。

也可能有一些策略可以增加我们模拟的计算成本,这些策略不像野生动物那样包含大量感知。例如,更详细地监测深地下物理动态可能会迫使我们的模拟者更仔细地计算这些动态,这会浪费计算周期在不太有意识的过程上,减少我们的模拟者可以运行的其他可能密集痛苦的计算量。

最后,请记住,一些减少痛苦的方法,比如更人道地屠宰农场动物,可以防止大量模拟的可怕经历副本,而不会明显改变我们的世界对我们的模拟者来说有多昂贵。

不同时是生物和模拟的副本

到目前为止,我一直假设如果我们在模拟中有许多副本,那么在多重宇宙的各个点上,我们在基础现实中也有一些副本。然而,我们也可能处于一个在基础级现实中没有镜像的模拟中。例如,也许我们模拟世界的物理定律与基础的物理定律不同,而且多重宇宙中没有其他非模拟宇宙共享我们模拟的物理定律。也许我们的世界包含模拟者引入的奇迹。等等。如果存在我们有模拟中的副本但不在基础中有副本的情况(除了可能在一些基础世界中存在极其罕见的玻尔兹曼大脑类型的副本,或者在多重宇宙中极低测度的宇宙中,特定的奇迹被硬编码到基础级物理定律中),这会放大短期行动的价值,因为我们能够影响我们的许多模拟副本,但不会有任何基础副本可以影响远期未来。

另一方面,也可能我们基本上所有的副本都在基础级现实中,没有精确的模拟对应物。这种情况可能发生的一个原因是,也许在足够的细节中模拟一个完整的人及其整个世界,以使该人在模拟中的选择反映生物版本的选择,这太难了。例如,也许计算上难以处理的量子效应被证明对人脑的高级动态至关重要,这些效应在硅中模拟太昂贵了。12我们认为这种情况越有可能,短期行动就显得越不重要。但正如我们所看到的,除非这种情况的概率非常接近1,否则短期还是长期更好的模糊性仍然没有解决。

即使所有模拟与所有基础文明都有戏剧性的不同,只要一些模拟生物认为它们在基础中,模拟论证仍然会生效。如果大多数几乎太空殖民的生物存在于模拟中,那么无论你的大脑运行的算法是什么,它最有可能是那些模拟之一,而不是在基础宇宙中。

我仍然有点困惑于如何在由于有限的内省和有限的理性,你不确定你是几个可能存在于不同地方的算法中的哪一个时进行人类学推理。但一个天真的方法似乎是在所有你可能是的算法中,你无法区分的算法之间平均分配概率。

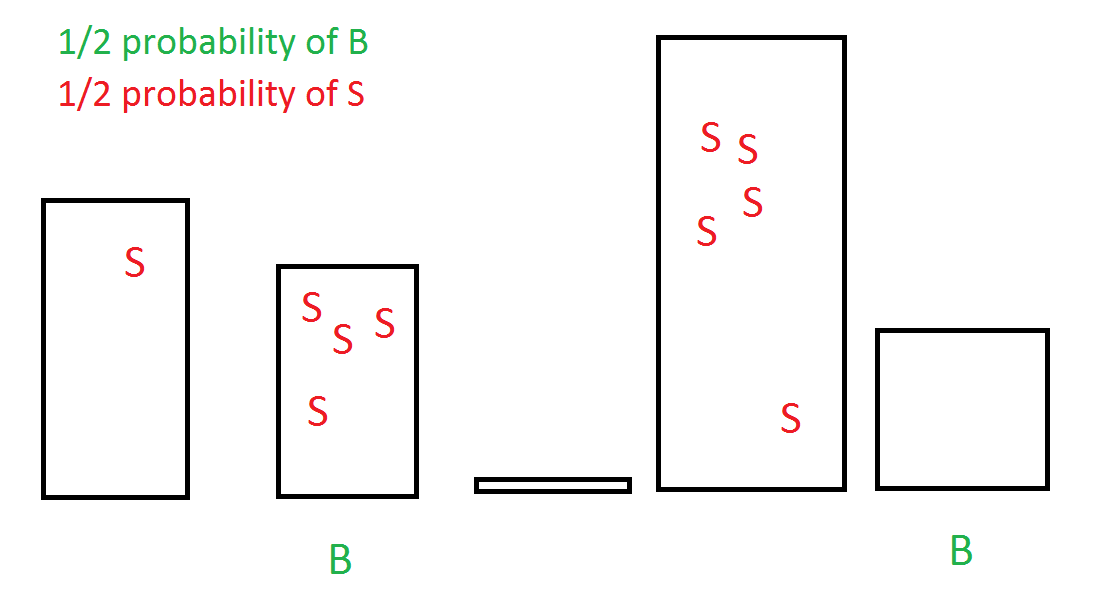

例如,假设你可能是的算法只有两种类型:(1)地球上的生物人类和(2)认为自己在地球上的模拟人类,这些模拟人类彼此都相同,但与生物人类不同。这在下图中说明,其中B代表生物人类,S代表共享相同认知算法的模拟人类。

考虑到你不确定你是B还是S,你将1/2的概率分配给每种算法。如果你是B,你可以影响你未来所有N个预期感知年的计算,而如果你是S,你只能影响E个感知年,但你有许多副本。计算最终与"基于你所有副本的计算"部分相同,因为

L = (你是B的概率) * (你的生物副本数量) * (每个副本的预期价值) + (你是S的概率) * (针对未来的工作没有影响,因为模拟中没有远期未来) = (1/2) * (fy * C * fC * E * fE) * (N * T * D) + (1/2) * 0,

和

S = (你是B的概率) * (你的生物副本数量) * (每个副本的预期价值) + (你是S的概率) * (你的非类唯我论模拟副本数量) * (每个副本的预期价值) = (1/2) * (fy * C * fC * E * fE) * E + (1/2) * (fy * C * N * fN) * E。

L/S最终与之前完全相同,在分子和分母中的1/2因子相消后。13

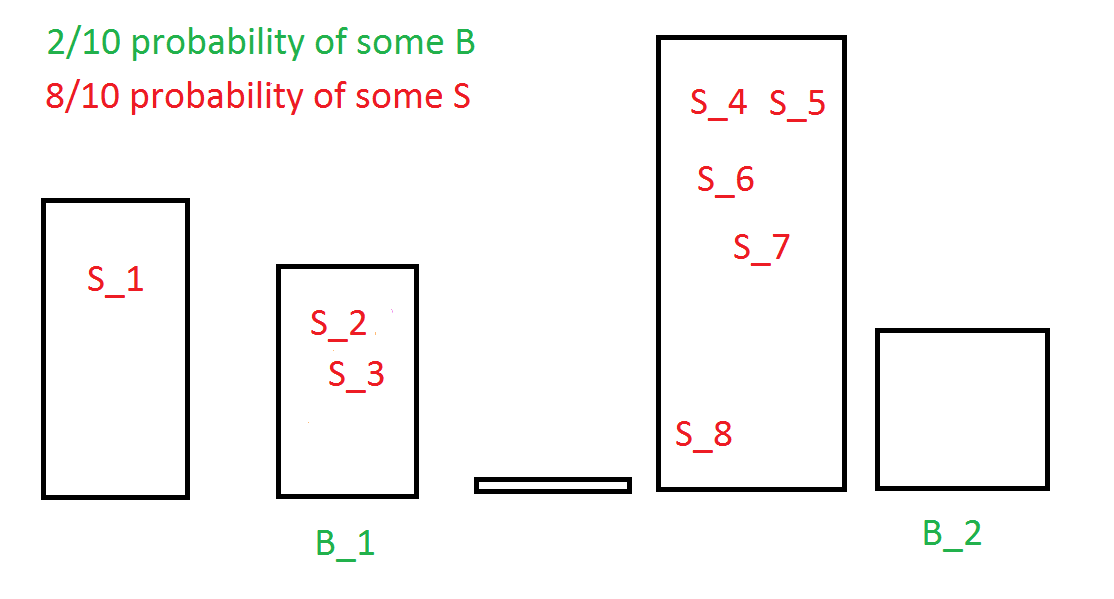

接下来,假设所有模拟副本彼此都不同,所以不再是你的一个副本做什么,其他副本就做什么的情况。在这种情况下,你可能是的算法有很多(在下图中标记为S_1, S_2, ...),其中大多数是模拟的。

现在你是生物的概率只是Pb,L/S的计算与"使用Bostrom式人类学和因果决策理论的计算"部分完全相同。

所以无论我们如何划分,我们似乎都得到了完全相同的L/S表达式。我没有检查这在所有情况下都有效,但这个发现似乎相当稳健。

唯我论和类唯我论模拟

由于在包含真实人物的角色扮演模拟中改变模拟细节更困难[即,与粗略模型的无生命物体相比,人更昂贵模拟],这些模拟往往在空间和时间上有一些边界,模拟在这些边界处结束。

对模拟的考虑是否有利于唯我论场景?特别是,运行~70亿次只有你是唯一心灵的模拟比运行包含世界所有人口的模拟要容易得多。在那些你比平均水平运行得多得多的超级智能文明中,你有比正常情况多得多的副本。所以你是否应该因此而更自私,因为其他人(特别是你不观察的远方人)可能不存在?

也许稍微有点。Robin Hanson:

你为退休储蓄或帮助埃塞俄比亚的穷人的动机可能会因为意识到在你的模拟中你永远不会退休,也没有埃塞俄比亚而减弱。

然而,我们不应该给唯我论模拟太多权重。也许有一些超级智能只模拟你的副本。但也可能有超级智能模拟其他人的副本而不是你。只模拟你的大量副本的超级智能可能很罕见。相比之下,模拟各种人的超级智能,其中一个可能是你,可能要常见得多。所以你可能有比唯我论副本多得多的非唯我论副本。

你也可能有许多类唯我论副本,这取决于类唯我论与非类唯我论模拟的相对频率。不模拟(非宠物)动物的类唯我论模拟可能比包含动物的模拟便宜得多,所以可能有,比如说,5或20倍多的省略动物的类唯我论模拟比包含动物的模拟?很难确切说,因为这取决于各种超级智能模拟者对各种模拟细节和真实程度的相对有用性或内在价值。尽管如此,只要不包含动物的类唯我论模拟的数量不比包含动物的模拟多几个数量级,帮助动物可能仍然非常重要。

类唯我论模拟的可能性并不会大幅提高帮助发展中国家人类相对于帮助动物的重要性,因为在一些类唯我论模拟中,发展中国家的人类也不存在。

类唯我论模拟的可能性可能是第一个给予那些靠近自己的人和自己可以直接观察到的人(稍微)更多道德权重的好理由。

名人

Jaan Tallinn和Elon Musk都认为他们很可能处于模拟中。具有讽刺意味的是,这种信念对有趣的科技百万富翁/亿万富翁来说可能比普通人更有道理(在著名/富有的人可能比普通人有更多副本的意义上),因为模拟强大的人可能在科学上更有用,也更有趣,而不是模拟,比如说,非洲农民。

那么富有和强大的人是否应该比平均水平更自私,因为他们可能比平均水平有更多的模拟副本?可能不应该,因为强大的人也可以比平均水平产生更多的利他主义影响,而且对他们来说代价更小。(事实上,帮助他人可能从长远来看无论如何都会让自己更快乐。)富裕的人类很少经历酷刑级别的痛苦(除了可能在生命结束时的一些情况 - 在这种情况下,医生协助自杀似乎是个好主意),所以即使一个人的大多数副本是唯我论的,专注于自己可能产生的道德善也很小。

唯我论模拟有多可行?

在不实际模拟那些其他人的情况下,伪造与其他人的个人互动可能很困难。所以你的朋友和家人可能也在被模拟。但你的熟人的行为如果他们也与完全模拟的人互动会更可信。最终,可能最容易的就是一次性模拟整个世界,而不是模拟片段并在边缘伪造发生的事情。我猜测大多数需要高度准确性的模拟包含任何给定时间在地球上存在的所有人类心灵(尽管不一定包括过去和未来的时间)。

也许可以为过去的人类提出一些类似于为你的熟人及其熟人进行详细模拟的论证:为了有真实的过去记忆,你必须在过去被模拟过,为了让你过去的互动真实,你必须在过去与其他精细模拟的人互动过。为了让你的父母和祖父母有真实的记忆,他们必须与真实的过去人互动过,他们的父母和祖父母也是如此,以此类推。我想知道是否可能在模拟越来越远的过去时,逐渐降低模拟的保真度,以至于,比如说,在模拟我们当前世界的大多数模拟分支的过去中,朱利叶斯·凯撒从未实质性地存在过?或者也许朱利叶斯·凯撒曾被详细模拟过一次,但然后从那些相同的初始条件模拟了多个后来的历史轨迹。

如果世界社交网络中存在断开的子图,可能会有只模拟你的子图的类唯我论模拟,但不清楚实际上是否存在许多断开的子图(除了一些微小的,如亚马逊中的孤立人群),也不清楚为什么模拟者会选择只模拟~99%的人口而不是100%。

那非人类动物呢?至少宠物、农场动物和宏观野生动物可能需要为了真实性而模拟,至少在被观察时。(也许这是有史以来第一个反对实时野生动物监测和工厂农场闭路电视的好论证。)如果所有动物都被模拟,生态系统动态会更可信和真实。所以我们有一些理由怀疑野生动物也被模拟了。然而,对此存在一些不确定性;例如,也许模拟者可以用相当粗略的大规模生态系统过程模拟(如浮游植物生长和地下分解)来逃脱。或者也许他们可以使用以前模拟的缓存结果。但一个准确的模拟可能需要模拟地球上的每个活细胞,以及地球地壳的一些基本物理特征。

话虽如此,我们通常应该期望在较低分辨率的模拟中有更多副本,因为运行低分辨率模拟比高分辨率模拟更容易。

开放问题:野生动物监测会有害吗?

比如说,更好地监测野生动物会显著增加野生动物痛苦的担忧有多重要,因为这会迫使模拟者更详细地模拟那些野生动物?如果我们的大多数副本存在于模拟而不是基础现实中,那么这个担忧就不能被轻易忽视。

这个问题似乎取决于特定的野生动物监测行为是否会影响荒野模拟的精细程度。也许无论我们如何监测,野生动物已经被详细模拟了,因为这些生物有我们不可避免会注意到的生态影响。相反,也许即使我们全天候用摄像头和运动追踪器监测野生动物,被监测生物的行为也会基于缓存的行为模式或相对简单的算法生成,类似于视频游戏中复杂的非玩家角色的行为。为了使荒野监测增加野生动物痛苦,它必须是我们的模拟处于这两个极端之间的情况—额外的监测量使得粗略和精细模拟自然生物之间产生差异。

尽管如此,似乎有一些可能性是这种情况,而荒野监测的好处也不一定看起来很大。作为一个例子,假设有50%的可能性野生动物已经被详细模拟,45%的可能性即使人类进行更多荒野监测,野生动物也不需要被详细模拟,5%的可能性更大的荒野监测会使简单模拟和复杂模拟野生动物之间产生差异。让我们忽略45%的情况,假设在这些情况下模拟的动物在道德上是微不足道的。假设在50%的野生动物已经被详细模拟的情况下,对给定一公顷土地的野生动物监测允许人类将该公顷上的痛苦减少,比如说,10%的基线水平B。同时,在5%的增加监测使简单和复杂荒野模拟产生差异的情况下,野生动物监测将痛苦从大约0(由于生物的微不足道)增加到(100% - 10%) * B在那一公顷上。(减去10%是因为监测减少了野生动物痛苦10%相对于基线B。)由于50% * 10% * B ≈ 5% * 90% * B,在这个例子中,野生动物监测的预期收益大致等于预期成本。我不知道这些示例数字是否合理,但乍看之下,通过监测增加痛苦的担忧似乎不能完全忽视。

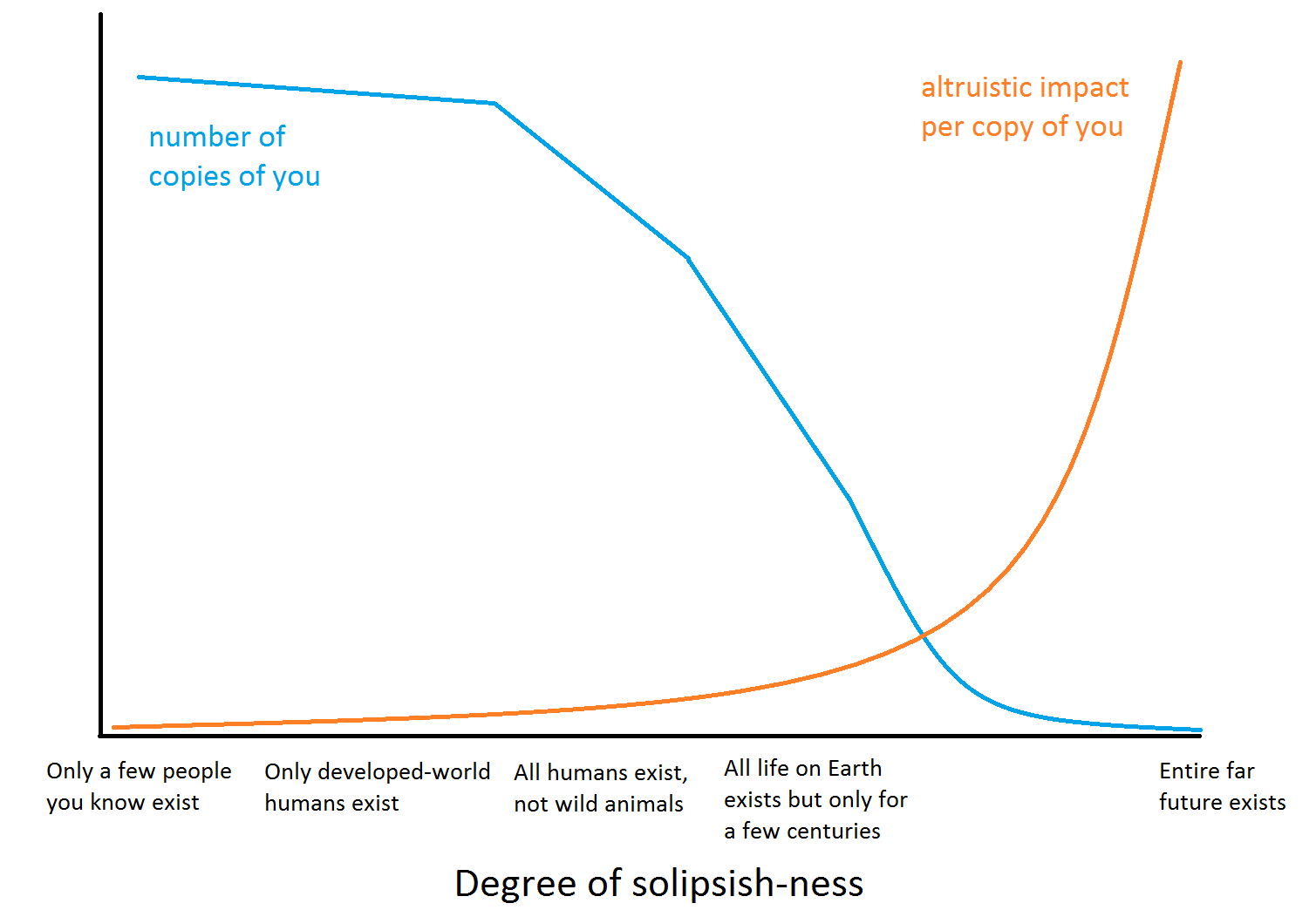

副本数量与每个副本影响之间的权衡

下图说明了我们可能期望找到的关于我们拥有各种类型副本数量的一些一般趋势。利他主义影响在唯我论程度的水平最高,两条曲线的乘积最大。这篇文章的主要观点是,最大值出现在哪里并不明显。请注意,即使你给模拟假说很低的概率,这个图表也是有意义的,因为你可以将"你的副本数量"转换为"你的预期副本数量",即(如果模拟常见,你的副本数量) * (模拟常见的概率)。

如果结果表明类唯我论模拟相当不准确,因此无法在更现实的世界中复现你的大脑的输入-输出行为,那么你可能不会在唯我论谱系的所有细节水平上都有副本,但你仍然应该对你的算法是否在更或更少长寿的高分辨率模拟中实例化,或者根本不在模拟中保持不确定性。

物理学中的痛苦或其他黑天鹅事件可能会拯救未来狂热

在这篇文章中,我一直假设我们可能减少的远期未来大部分痛苦将以超级智能运行的智能计算代理的形式出现。这些超级智能拥有的计算能力越多,它们创造的有情心灵就越多,它们也会创造更多我们在地球上的人类模拟。

但如果针对未来的行动的大部分影响不是来自对智能计算的影响,而是来自其他更重要的东西呢?一个例子可能是如果我们认为基础物理学中的痛苦在我们光锥的长期未来中总体上极其重要。如果有一种方法可以永久改变基础物理学的性质,这种改变不会自然发生(或者至少在谷歌规模的时间内不会自然发生),那么可能改变物理学中的痛苦量基本上永远(或者至少在谷歌规模的时间内),这可能会压倒一切其他可以实现的改变。没有数量的善行在大量模拟中的镜像可以与之竞争(假设一个人足够关心基础物理学相对于其他事物)。

另一个更加不可能的场景,在这种情况下,关注远期未来会比关注短期重要得多,是以下情况。假设先进文明发现了运行疯狂数量计算的方法 - 如此之多的计算,以至于他们可以用他们计算资源的一小部分模拟所有他们可能想要探索的早期生物行星的有趣变体。在这种情况下,F可能极小,因为额外模拟可能会有递减的回报,超级智能可能会将其余的巨大计算资源用于其他事情。然而,对这种情况的一个反驳是,一小部分文明可能会内在地重视运行他们自己和/或其他文明的祖先模拟,在这种情况下,所有计算中用于此类模拟的比例可能不会接近零,如果有大量的计算能力变得可用。所以F似乎有一个下限,大致是(按计算能力加权的内在重视祖先模拟的文明比例) * (他们花在此类模拟上的计算资源比例)。直观地说,我猜这个界限可能不会小于10-15或10-20或类似的数字。(例如,在人类目前的~1010人口中,可能至少有一个人会,可悲地在我看来,内在地重视准确的祖先模拟。)

进一步研究的价值

这篇文章论证了我们不应该排除短期关注的行动(如在未来几十年内减少地球生态系统中的野生动物痛苦)可能具有天文价值的可能性。然而,我们还不能轻易得出结论,所以这篇文章不应被视为一张空白支票,只关注减少短期痛苦而不进行进一步探索。事实上,如果没有思考远期未来,就不会发现像这样的论点。

在我们了解更多之前,我个人倾向于做短期工作、远期未来工作和关于这类问题的元级研究的混合。然而,正如这篇文章所示,一个纯粹的风险中性期望值最大化者可能倾向于主要关注远期未来,因为即使考虑到模拟论证,关注远期未来似乎仍然具有稍高的期望值。关于是否更多地关注短期还是远期未来的决定的进一步研究的信息价值似乎相当高。

致谢

Carl Shulman启发了这篇文章中的几个观点,并对最终版本提供了广泛的反馈。我的思考也受益于与Jonah Sinick、Nick Beckstead、Tobias Baumann和其他人的讨论。

脚注

- Eliezer Yudkowsky 可能不喜欢我将关注远期未来描述为一种温和的帕斯卡勒索形式:

"帕斯卡勒索"这个短语被完全曲解,用来指一些人在面对高风险慈善提议时显然会产生的被勒索的情感感觉,无论它是否应该有低概率。这足以让我后悔最初发明了"帕斯卡勒索"这个术语[...]。

当然,影响远期未来确实比影响近期有更低的成功概率。概率差异只是相对较小(可能在几个数量级之内)。 (返回)

- 对模拟人类来说,1感知年可能发生在远少于1恒星年的时间内,假设模拟有高时钟速度。 (返回)

- 这在增加幸福方面尤其如此,在生物生物中我们面临享乐适应。在负面功利主义者通过减少人口规模来减少痛苦的情况下,这不太适用,因为防止个体存在完全消除了其痛苦,无论它是生物的还是数字的。 (返回)

- N * T * D乘积中的单位是(感知年数) * (帮助给定感知年的道德价值) * (实际帮助任何给定感知年的概率折扣)。 (返回)

- 这里的单位是(E感知年) * (每感知年1单位道德价值)。这里的强度因子是每感知年1单位道德价值,因为长期帮助的强度因子T是相对于短期帮助的强度因子定义的。这里没有概率折扣,因为长期折扣D被定义为长期帮助的概率折扣相对于短期帮助。 (返回)

- 注意,这些表达式假设你所有副本的感知都相同,因为它们假设一个常数比率fy,将一般人类的感知年转换为你的一个副本的生命年。然而,我们可能会稍微少关心那些在较低分辨率模拟中的自己的副本(例如,只表示粗略神经元水平细节而不是亚神经元水平细节的模拟,假设大脑的高级行为在两种情况下相同)。如果低分辨率模拟中的其他人的感知程度与你的副本的感知程度降低程度相同,那么低分辨率模拟中的副本能够帮助的感知年将相应降低。在这种情况下,本文的计算将你在低分辨率模拟中只有,比如说,1/3个副本,其感知年是正常的1/3是可以的,只要该副本能做的帮助平均也只有1/3那么多。这是因为本文假设我们能做的短期帮助量与我们拥有的副本数量成正比。换句话说,我们可以把一个副本看作是"一个帮助力单位",较低分辨率的自己实例是不到一个完整副本,因为它们的帮助力较小。 (返回)

- 假设我们可以用简单的方式为任何给定的人类出生指定一个唯一的索引,这忽略了流产、死产、双胞胎、出生是否发生在孩子开始还是结束离开产道时等复杂情况。对于基本上同时在地球两端发生的出生,同时性的相对性也可能变得相关。 (返回)

- earthwormchuck163后来改变了他/她的想法关于这一点。 (返回)

- 栖息地减少可能仍然会减少一点痛苦,因为即使在两种情况下进行的总计算量相同,如果栖息地更小,那么更大比例的计算用于人类,而人类的生活比野生动物更好。例如,假设如果我们不减少野生动物栖息地,将有一些数量Y的模拟,其中每个人类感知年对应10,000个野生动物感知年。假设如果我们确实减少野生动物栖息地(比如说,一个荒谬的高数量:90%),那么每1个人类感知年对应1000个野生动物感知年。如果用于此类模拟的总感知年计算能力是恒定的,那么新的模拟数量Z将满足

Y * (10,000 + 1) = Z * (1000 + 1),

即Z = 9.991 * Y。新的野生动物痛苦量将只有Z * 1000 = 9.991 * Y * 1000 = 9,991 * Y感知年,而不是10,000 * Y。 (返回)

- 或者也许模拟者会运行更多更便宜的模拟,但不足以完全抵消栖息地减少的影响。想象一条模拟需求曲线,其中"价格"是运行单个模拟的成本。如果模拟的大部分计算都用于荒野的有情部分(而不是不太有情的物理过程,如天气),那么将荒野减少X%应该将每个模拟的成本减少约X%。如果需求是非弹性的,那么需求量(即运行的模拟数量)的增加不会像每个模拟成本的减少那么多。假设价格下降100 * fp%,需求量增加100 * fq%。由于需求是非弹性的(即弹性 < 1),

|(需求量百分比变化)/(价格百分比变化)| < 1

|(100 * fq) / (-100 * fp)| < 1

|-1| * |fq / fp| < 1

fq / fp < 1,其中最后一行成立是因为fq和fp都是正数。最后,注意总痛苦基本上是(每个模拟的成本) * (模拟数量),这个乘积的新值是

旧的每个模拟成本 * (1 - fp) * 旧的模拟数量 * (1 + fq)

= 旧的每个模拟成本 * 旧的模拟数量 * (1 + fq - fp - fp * fq),如果fq < fp,这是一个减少。证毕。 (返回)

- 话虽如此,正如Carl Shulman向我指出的,地球上相当一部分野生动物模拟可能也没有太多感知 - 例如,动物的身体、天气、火灾、海洋洋流等。 (返回)

- 当然,模拟不必只使用数字计算。如果由于某种原因,生物神经元的量子效应对人脑执行的算法至关重要,而这些算法无法在经典计算机上模拟,人们仍然可以创建生物大脑形式的模拟人类,并将它们连接到虚拟现实接口,就像在《黑客帝国》中一样。当然,这种方法也可能存在困难。例如,躺在那里接收虚拟现实输入的身体不会像真实生物人类的身体那样通过锻炼改变大脑。也许运动和锻炼对大脑的影响可以不太困难地添加进去,但也许不行。所以至少在一些情况下,在计算上难以处理到足以模拟大脑,以至于它甚至只能反映生物大脑的高级功能行为。

上述困难的一个暴力解决方案可能是将整个行星转化为类似地球的样子,在那个行星上放置真正的细菌、真菌、植物、动物和人类,并伪造来自外太空的信号(一种对模拟的《楚门的世界》方法),但这会极大地浪费行星资源(即,只运行一个模拟就需要一整个行星),所以我怀疑许多先进文明会这样做。

即使模拟无法复制生物心灵的高级功能行为,仍然存在一个问题,即是否可以制作一些模拟在"主观上无法区分"于生物人脑,在大脑无法分辨它是哪种算法的意义上,即使模拟在功能上与原始生物版本不完全相同。我怀疑这是可能的,因为我们用来反思自己和我们在世界中的位置的算法似乎不超出经典计算的范围,而且可能并不非常复杂。但我想可能在这个过程中需要计算上要求很高的量子算法。 (返回)

- 在这种设置中,假设fN = fX * fC可能不再合理,正如我在前一节中所做的那样,因为fC是所有文明中在母星上有B算法的比例,而fN是先进计算能力中用于S算法的比例。由于B和S是不同的算法,可能不太合理的是,例如,如果B的数量是两倍,那么S的数量也会是两倍。尽管如此,由于B和S足够相似,以至于你无法用你有限的推理能力分辨出你是哪一个,fC和fN可能仍然有很强的相关性是有些合理的。例如,即使不可能准确模拟B算法,因为它们涉及难以计算的量子效应,仍然可能存在S算法,它们是B的非量子准确版本,如果B算法在生物行星上非常常见,那么S算法在模拟中应该也非常常见。 (返回)